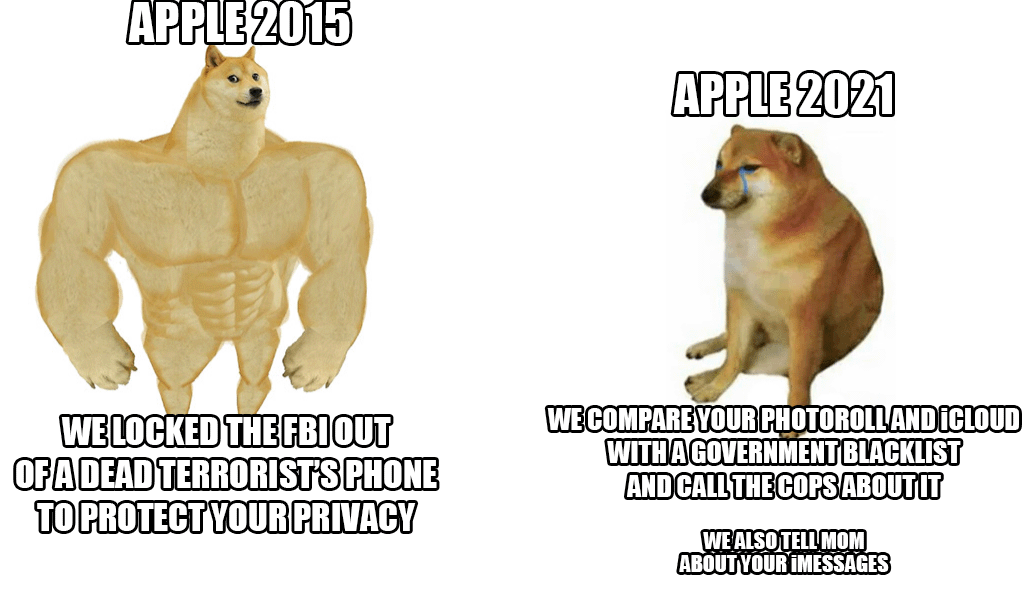

Στα τέλη της περασμένης εβδομάδας, η Apple παρουσίασε ένα νέο σύστημα κατά της κακοποίησης παιδιών που θα σαρώνει σχεδόν όλες τις φωτογραφίες iCloud όλων. Αν και η ιδέα ακούγεται καλή με την πρώτη ματιά, καθώς τα παιδιά πρέπει πραγματικά να προστατεύονται από αυτή τη δράση, ο γίγαντας του Κουπερτίνο επικρίθηκε ωστόσο από μια χιονοστιβάδα - όχι μόνο από χρήστες και ειδικούς ασφαλείας, αλλά και από τις τάξεις των ίδιων των εργαζομένων.

Σύμφωνα με τις τελευταίες πληροφορίες από έγκριτο πρακτορείο Reuters ορισμένοι εργαζόμενοι εξέφρασαν τις ανησυχίες τους για αυτό το σύστημα σε μια εσωτερική επικοινωνία στο Slack. Υποτίθεται ότι θα πρέπει να φοβούνται πιθανή κατάχρηση από αρχές και κυβερνήσεις, οι οποίες θα μπορούσαν να κάνουν κατάχρηση αυτών των δυνατοτήτων, για παράδειγμα, για να λογοκρίνουν άτομα ή επιλεγμένες ομάδες. Η αποκάλυψη του συστήματος πυροδότησε μια έντονη συζήτηση, η οποία έχει ήδη πάνω από 800 μεμονωμένα μηνύματα στο προαναφερθέν Slack. Με λίγα λόγια, οι εργαζόμενοι ανησυχούν. Ακόμη και ειδικοί σε θέματα ασφάλειας έχουν επιστήσει προηγουμένως την προσοχή στο γεγονός ότι σε λάθος χέρια θα ήταν ένα πραγματικά επικίνδυνο όπλο που χρησιμοποιείται για την καταστολή ακτιβιστών, την αναφερόμενη λογοκρισία τους και τα παρόμοια.

Τα καλά νέα (μέχρι στιγμής) είναι ότι η καινοτομία θα ξεκινήσει μόνο στις Ηνωμένες Πολιτείες. Προς το παρόν, δεν είναι καν σαφές εάν το σύστημα θα χρησιμοποιηθεί και εντός των κρατών της Ευρωπαϊκής Ένωσης. Ωστόσο, παρ' όλες τις επικρίσεις, η Apple στέκεται μόνη της και υπερασπίζεται το σύστημα. Υποστηρίζει πάνω από όλα ότι όλος ο έλεγχος γίνεται εντός της συσκευής και από τη στιγμή που υπάρχει αντιστοιχία, τότε μόνο εκείνη τη στιγμή η υπόθεση ελέγχεται ξανά από έναν υπάλληλο της Apple. Μόνο κατά την κρίση του θα παραδοθεί στις αρμόδιες αρχές.

Θα μπορούσε να είναι σε ενδιαφέρει

Δεν θα ήθελα να αλλάξω από το iCloud σε κάτι ασφαλές και πραγματικά ιδιωτικό, αλλά αν η Apple επιμείνει, θα σταματήσω να τους πληρώνω ούτως ή άλλως.

Θα είναι ενεργό (προς το παρόν) μόνο στις Η.Π.Α

Δεν έχει ιδιαίτερη σημασία πού θα εφαρμοστεί νομοθετικά. Αυτή η τεχνολογία θα είναι ήδη εκεί έξω και θα αναπτυχθεί. Αυτός είναι ο μεγαλύτερος κίνδυνος.